Изкуствен интелект – предизвикателства пред зачитането на правата на човека

.png)

„Дигитална демокрация“ (“Digital Democracy”) е поредица на Български център за нестопанско право, в която чрез онлайн материали и семинари говорим за човешките и гражданските ни права в дигиталната среда. Ще търсим отговори на актуални въпроси заедно с участието на граждански организации и активисти, младежи, правозащитници, професионалисти в IT сектора, журналисти, институции.

- За да сте част от дискусията онлайн – включете се в пространството „Дигитално участие“ в платформата и приложение Slack

- За да получавате известия за нови материали и събития – присъединете се към общността „Дигитално участие“ във Viber, като напишете ДИГИТАЛНО УЧАСТИЕ в полето за търсене и изберете опцията Join.

Ако през средата на миналия век изкуственият интелект (ИИ) е бил само тема на теоретични научни статии, то днес системи, базирани на ИИ, са широко разпространени във всички аспекти на живота ни – от търсенето на информация в интернет до оптимизиране на селското стопанство, от робота прахосмукачка, който се движи сам из дома ни, до колите, които се управляват без наша намеса по пътищата. Системите, основани ИИ, намират своето място и в публичния сектор, като им се възлагат все по-амбициозни задачи – автоматизиране на разпределението на социални помощи, подпомагане на хора, търсещи работа, оценка на риска при базирано на пола домашно насилие и др. Днес ИИ вече е реалност, на която се възлагат огромни надежди за бъдещето развитие на човечеството.

От 2018 г. развитието ИИ също така е официална политика на Европейския съюз. В Стратегията на Европейската комисия (ЕК) за развитие на ИИ са формулирани три цели пред Съюза:

- Да постави Европа начело на технологичното развитие и да насърчава възприемането на ИИ от публичния и частния сектор.

- Да се подготвят социално-икономически промени, предизвикани от ИИ.

- Да осигури подходяща етична и правна рамка.

ИИ се възприема като основен фактор за икономическото развитие и възможност за решаване на много предизвикателства – от лечение на болести до опазване на околната среда. Наред с това обаче използването на ИИ създава и нови етични и правни проблеми, както и възможни нарушения на правата на човека. В това отношение основен принос през последните две години на Европейската комисия (ЕК) е създаването на Насоки относно етичните аспекти за надежден ИИ, а в първата четвърт на 2021 г. се очаква ЕК да направи и предложение за правно регулиране на ИИ. Освен ЕК и Съветът на Европа също обръща сериозно внимание за рисковете свързани с ИИ, като през април 2020 г. приема Препоръка за въздействието на алгоритмични системи върху правата на човека.

Какво всъщност е ИИ?

Според проучване, проведено от името на ЕК, 8 от 10 служители в компании в ЕС твърдят, че знаят какво е ИИ. Въпреки това, ако помолим няколко човека да ни обяснят какво ИИ, вероятно няма да получим един и същ отговор. Това е така, т.к. няма универсално възприета дефиниция на ИИ, а с термина обикновено се обозначават различни приложения и нови технологични разработки, които се основават на разнообразни технологични решения.

Едно просто обяснение е, че ИИ дава възможност на машините да анализират средата или голям обем данни и на база получената информация да вземат решения с известна степен на автономност за постигане на определена цел (за разлика от алгоритми, които на база предварително зададени правила обработват подадената информация и не се ръководят от целта).

В първото си Съобщение относно ИИ от април 2018 г., Европейската комисия използва следната дефиниция:

Наименованието „ИИ“ се използва за системи, които показват интелигентно поведение, като анализират своята среда и — с известна степен на самостоятелност — предприемат действия за постигане на конкретни цели.

Базираните на ИИ системи могат да бъдат изцяло софтуерни — действащи във виртуалния свят (напр. гласови асистенти, софтуер за анализ на изображения, търсачки, системи за разпознаване на глас и лица), а могат и да бъдат внедрени в хардуерни устройства (напр. усъвършенствани роботи, автономни автомобили, дронове или приложения за „интернет на нещата“).

В Бялата книга за ИИ, публикувана от ЕК през април 2019, се използва следното определение:

С две думи ИИ е набор от технологии, които съчетават данни, алгоритми и изчислителна мощ.

Вероятно, най-подробният анализ на понятието ИИ, създаден на ниво ЕС, можем да намерим в документа “Определение за ИИ: основни възможности и научни дисциплини”, разработен от Експертна група на високо равнище по въпросите на изкуствения интелект. Предложената дефиниция от Експертната група е:

„Системите с изкуствен интелект (ИИ) са софтуерни (а вероятно и хардуерни) системи, създадени от хора, които с оглед на дадена сложна цел действат в рамките на физическото или цифровото измерение, като възприемат заобикалящата ги среда чрез събиране на данни, тълкуват събраните структурирани или неструктурирани данни, разсъждават въз основа на познанието или обработват информацията, получена от тези данни, и вземат решение за предприемане на най-доброто(добрите) действие(действия) за постигане на дадената цел. Системите с ИИ могат или да използват символно представени правила, или да усвояват цифров модел и могат да адаптират поведението си, като анализират начина, по който средата е засегната от предишни техни действия.

Като научна дисциплина ИИ включва няколко подхода и техники, като например машинно самообучение (специфични примери за което са дълбокото самообучение и обучението с утвърждение), машинно разсъждение (което включва планиране, изготвяне на график, моделиране на познанието и разсъждение, търсене и оптимизация) и роботика (която включва контрол, възприятие, сензори и задвижващи механизми, както и интегрирането на всички други техники в кибер-физически системи)“.

ИИ и правата на човека

С все по-широкото въвеждане на ИИ в различни процеси на вземане на решения, които директно засягат хората, възникват все повече проблеми, свързани с опазването на правата на човека като: Кой носи отговорност, когато права на човека са нарушени в следствие решение, взето на база ИИ?; Възможно ли е системи, основани на ИИ, да са безпристрастни и недискриминационни?

Опасенията за възможни нарушения на правата на човека във връзка с използване на системи с ИИ, обаче не трябва да са причина за отричане на технологията. При вземане на решения от човек нарушения са също възможни, но опитът ни в идентифицирането им и съществуващите механизми за реакция, създават известна степен на доверие в тях. Това означава, че при използване на ИИ следва да се разработят и нови механизми за защита правата на човека и законова рамка, които да гарантират зачитането на съществуващите стандарти за спазване на правата на човека в контекста на новите технологии.

Важно е да не забравяме и че съществуването на системите за вземане на решения, основани на ИИ, се обосновават от взаимодействието им с хората. Т.е. самите математически и изчислителни конструкции в основата на ИИ нямат негативно въздействие върху правата на човека, а тяхното приложение и въвеждане в процеси може да доведе до такова. В общия случай за ИИ не е изначално присъщо да дискриминира по пол, религия или друг признак и няма предразсъдъци, но на база получената информация той може да придобие съществуващи вече в обществото ни такива. Прост пример е система, на която е зададено да намери най-подходящите кандидати за позицията „програмист.“ Системата в този случай е възможно да оптимизира информацията за тази професия и да приоритизира кандидатите мъже, т.к. в обществото ни тази професия се счита за „мъжка.“

Прибързано или ненужно за постигането на поставените цели въвеждане на ИИ са хипотезите, при които има най–голяма възможност за нарушение на правата на човека. Пример от българската практика е решението на Комисията за защита на личните данни, според което въвеждане на видеонаблюдение с възможност за лицево разпознаване, базирано на ИИ, в училище противоречи на правото на защита личните данни.

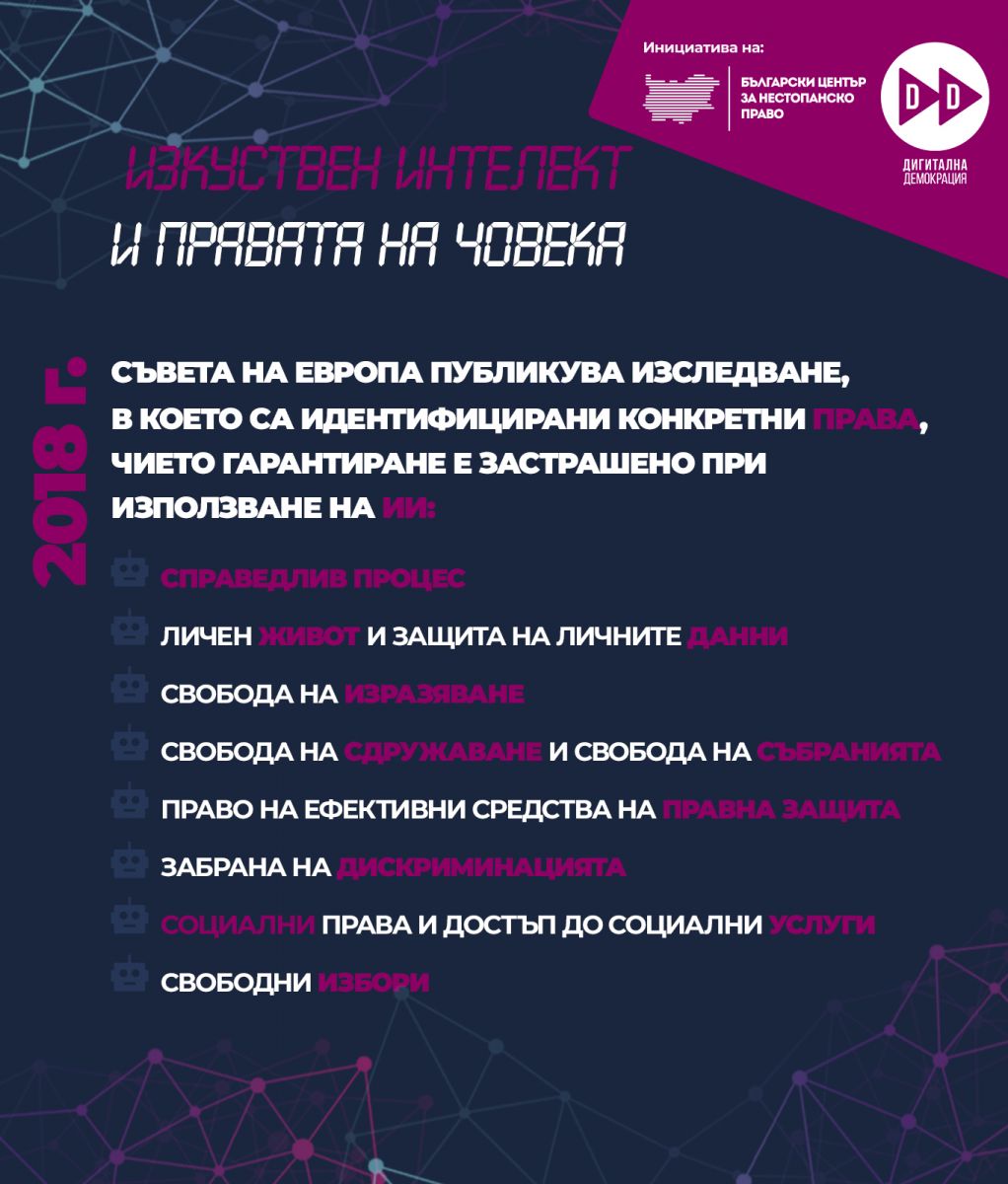

В рамките на ЕС от особена важност по отношение на защита правата на човека в контекста на ИИ технологии са изследванията на Съвета на Европа и на Агенция на Европейския съюз за основните права (FRA). В публикувано през 2018 г. изследване на Съвета на Европа са идентифицирани конкретни права, чието гарантиране е застрашено при използване на ИИ:

- справедлив процес

- личен живот и защита на личните данни

- свобода на изразяване

- свобода на сдружаване и свобода на събранията

- право на ефективни средства на правна защита

- забрана на дискриминацията

- социални права и достъп до социални услуги

- свободни избори

През 2019 г. Съветът на Европа публикува и 10 стъпки за защита на правата на човека при използване на ИИ. В документа на първо място се поставя нуждата от правна рамка, която да регламентира извършването на оценка на въздействието върху правата на човека при въвеждане на ИИ системи в публичния сектор. Нуждата от оценка на въздействието се подчертава и в доклада за ИИ и основните права на Агенция на Европейския съюз за основните права (FRA) от 2020 г. Към момента подобна оценка е задължителна само по отношение на системи за обработка на личните данни. В този случай при установяване на висок риск се изискват допълнителни консултации с надзорен орган и е възможно въвеждането на анализираната система да бъде спряно.

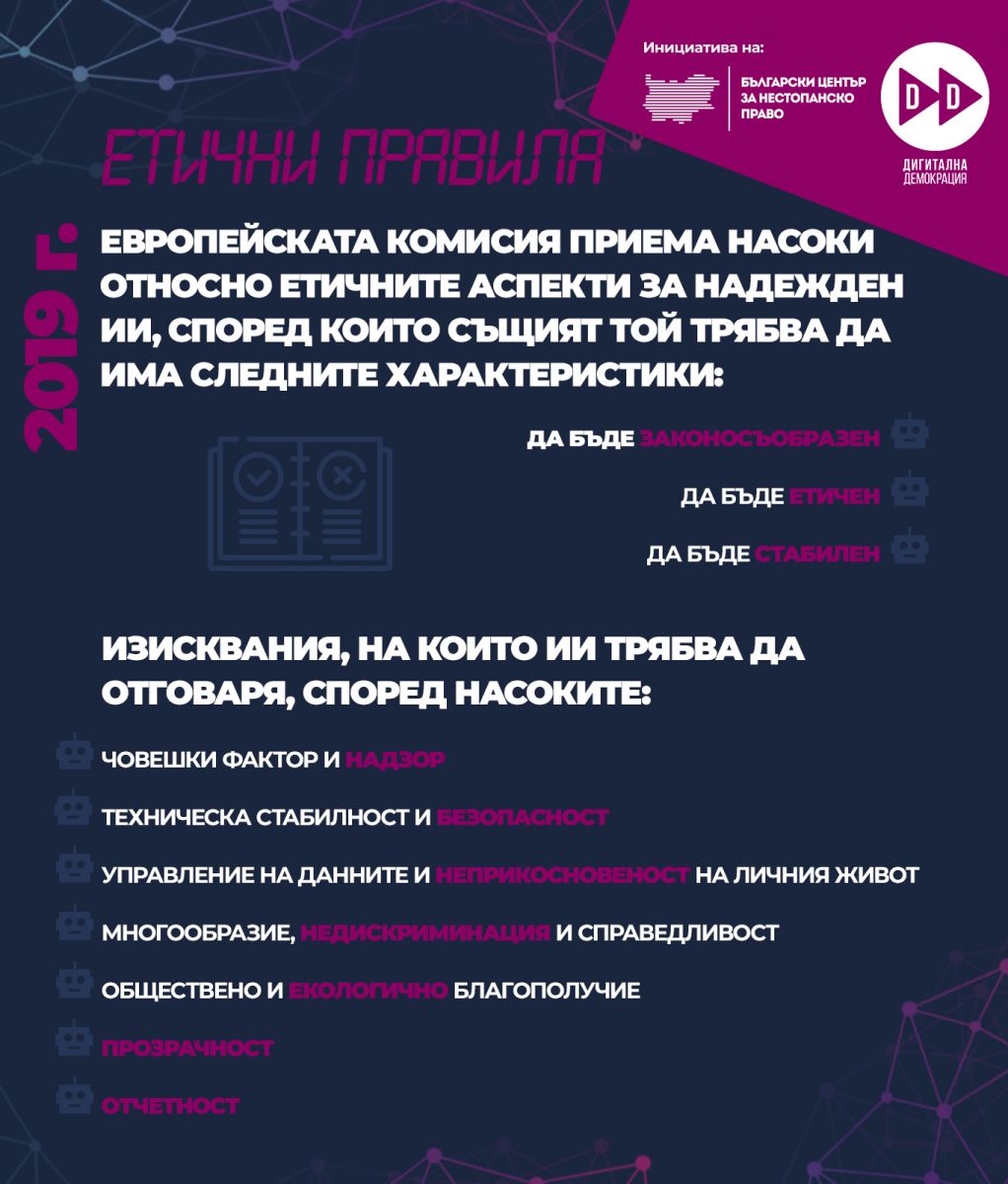

Етични правила

Вероятно, едно от най-големите постижения на ЕС по отношение на защитата на правата на човека във връзка с ИИ са приетите през 2019 г. след обществено обсъждане Насоки относно етичните аспекти за надежден ИИ. Въпреки че те нямат правно обвързваща сила, залегналите в тях препоръки вероятно ще са в основата на очакваните през 2021 г. законодателни предложения.

Според Насоките надежден ИИ трябва да има следните характеристики:

- той следва да е законосъобразен, като се придържа към всички приложими законови и подзаконови актове

- той следва да е етичен, като гарантира зачитането на етичните принципи и ценности

- той следва да е стабилен от техническа и от социална гледна точка, тъй като и при най-добри намерения е възможно системи с ИИ да причинят неумишлено вреди

В Насоките също така е предоставен и (неизчерпателен) списък на изисквания, на които системите с ИИ следва да отговорят:

- Човешки фактор и надзор – Включително основни права, човешки фактор и човешки надзор

- Техническа стабилност и безопасност – Включително устойчивост на атака и сигурност, резервен план и обща безопасност, точност, надеждност и възпроизводимост

- Управление на данните и неприкосновеност на личния живот – Включително зачитане на правото на неприкосновеност на личния живот, качество и цялост на данните и достъп до данни

- Прозрачност – Включително проследимост, обяснимост и комуникация

- Многообразие, недискриминация и справедливост – Включително избягване на несправедливи предубеждения, достъпност и универсален дизайн и участие на заинтересованите страни

- Обществено и екологично благополучие – Включително устойчивост и дейности, съобразени с околната среда, социално въздействие, общество и демокрация

- Отчетност – Включително отчетност, свеждане до минимум и докладване на отрицателно въздействие

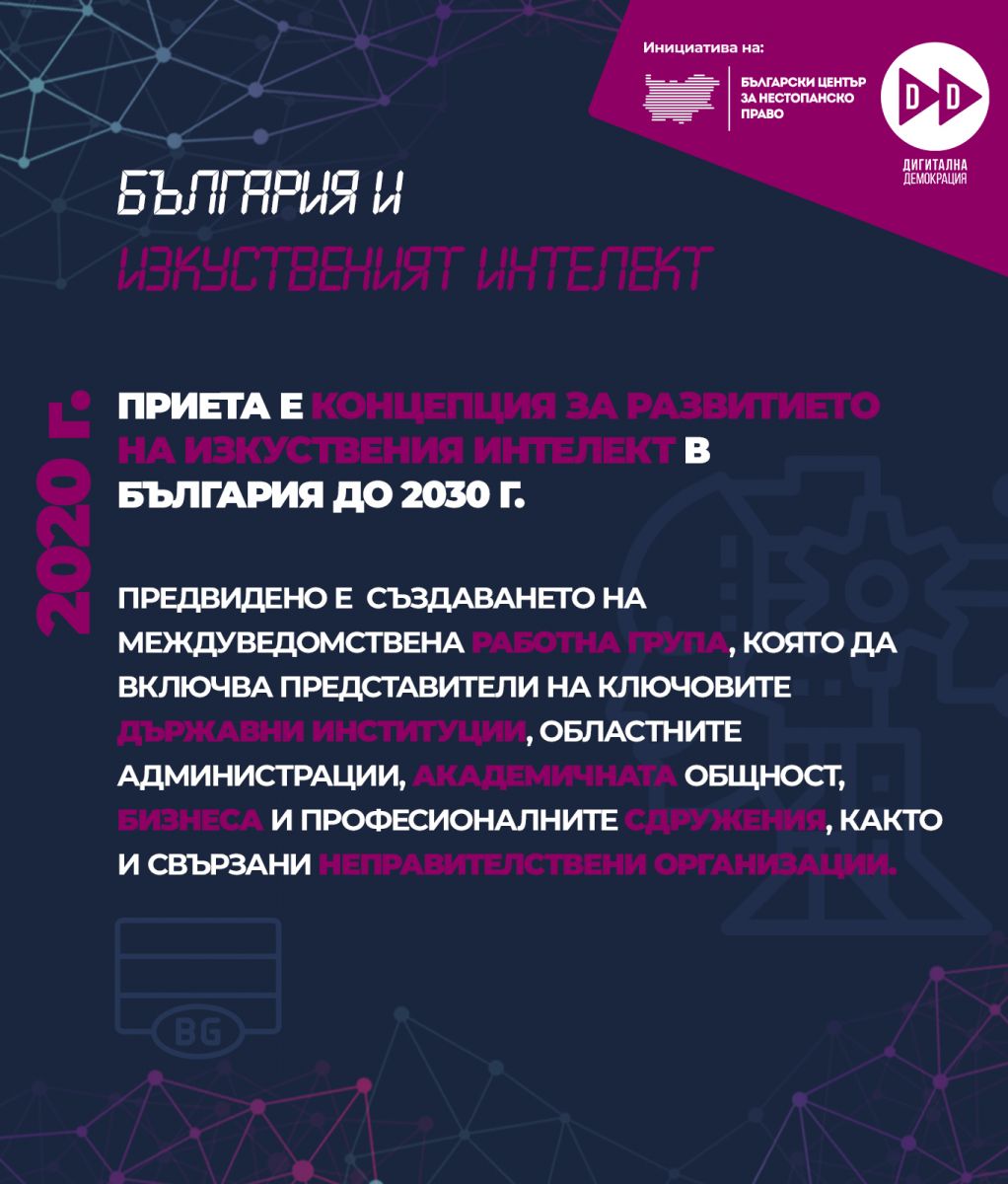

България и ИИ

В България приемането на законодателство, регулиращо ИИ и гарантиращо опазването на правата на човека във връзка с използване на системи с ИИ е все още на базово ниво. В общи линии то се изчерпва до Закона за защита на личните данни, чрез който е въведено законодателството на ЕС за защита на личните данни.

Въпреки това като държава членка на ЕС и България в известна степен следва общата политика за развитие на ИИ. Така в Плана за възстановяване и устойчивост се предвижда сериозно финансиране от над половин милиард лева за изграждане на училищна STEM среда, с която се цели да се повиши дигиталната грамотност включително и чрез въвеждане на нов предмет „изкуствен интелект“ – важна стъпка, т.к. осигуряването на „ИИ грамотност“ е една от 10-те стъпки за гарантиране на правата на човека във връзка с ИИ, предложени от Съвета на Европа.

В края на 2020 г. се прие и КОНЦЕПЦИЯ ЗА РАЗВИТИЕТО НА ИЗКУСТВЕНИЯ ИНТЕЛЕКТ В БЪЛГАРИЯ ДО 2030 г. По отношение на законодателната дейност свързана с ИИ, в Концепцията изрично е подчертано, че следва да се спазват международното право, свързано със защита правата на човека. Като основни актове са изведени:

- Конвенция за защита на правата на човека и основните свободи, 1950 г.

- Международен пакт за политически и граждански права, 1966 г. ∙ Международен пакт за икономически, социални и културни права, 1966 г.

- Конвенция №108 за защита на лицата при автоматизираната обработка на лични данни, 1981 г.

- Харта на основните права на Европейския съюз, 2009 г.

- Регламент (ЕС) 2016/679 на Европейския парламент и на Съвета относно защитата на физическите лица във връзка с обработването на лични данни и относно свободното движение на такива данни и за отмяна на Директива 95/46/EО (Общ регламент относно защитата на данните), 2016 г

Въпреки това прави впечатление, че в Концепцията няма предвидени законодателни инициативи, а по-скоро се основава на изчакване на законодателство на ЕС. Също така, по отношение на транспонирането на правото на ЕС е подчертана нуждата от ограничаване на административното регулиране и административния контрол върху стопанската дейност, но не е предвидена оценка на въздействието върху правата на човека и процес на обществени консултации (две от стъпките предложени от Съвета на Европа).

В Концепцията е предвидено и създаване на Междуведомствена работна група, която да включва представители на ключовите държавни институции, областните администрации, академичната общност, бизнеса и професионалните сдружения, както и свързани неправителствени организации. Нейната задача ще бъде да анализира цялостното състояние на сектора и да изготви оперативен Национален план/пътна карта за изпълнение на Концепцията, където да бъдат определени конкретните мерки, срокове, отговорни институции и организации, очаквани резултати и индикатори, източници на необходимите финансови ресурси, както и организация за отчет на изпълнението и периодична актуализация. Доколкото е положително предвиденото включване на неправителствени организации в Работната група, следва да се подчертае, че част от тях трябва да са правозащитни, за да се гарантира, че Националният план е в съответствие с нуждите от гаранции за защита правата на човека.

„Както някога парната машина или електричеството, така в момента ИИ трансформира нашия свят, общество и промишленост.“

Така ЕК описва ИИ, но докато чрез него превръщаме в реалност доскоро смятани за научна фантастика идеи, не трябва да забравяме за етичните и правни въпроси, които тази бързо развиваща се технология води след със себе си.

Автор: Захари Янков, Български център за нестопанско право

Източници:

https://fra.europa.eu/sites/default/files/fra_uploads/fra-2020-artificial-intelligence_en.pdf

https://builtin.com/artificial-intelligence

https://ec.europa.eu/digital-single-market/en/artificial-intelligence?etrans=bg

https://ec.europa.eu/digital-single-market/en/news/communication-artificial-intelligence-europe

https://search.coe.int/cm/pages/result_details.aspx?objectid=09000016809e1154

https://eur-lex.europa.eu/legal-content/BG/TXT/HTML/?uri=CELEX:52018DC0237&from=en

https://eur-lex.europa.eu/legal-content/BG/TXT/HTML/?uri=CELEX:52020DC0065&from=EN#footnoteref34

https://ec.europa.eu/newsroom/dae/document.cfm?doc_id=60666

https://www.cpdp.bg/?p=element_view&aid=2149

https://rm.coe.int/algorithms-and-human-rights-en-rev/16807956b5

https://www.mtitc.government.bg/sites/default/files/koncepciyazarazvitienaiivbulgariyado2030.pdf

.jpg) Поредицата материали и онлайн семинари „Дигитална Демокрация“ (“Digital Democracy”) реализираме с подкрепата на Фондация „Америка за България“. Изявленията и мненията, изразени в поредицата, принадлежат единствено на Български център за нестопанско право и участващите, автори и говорители и не отразяват непременно вижданията на Фондация Америка за България или нейните партньори.

Поредицата материали и онлайн семинари „Дигитална Демокрация“ (“Digital Democracy”) реализираме с подкрепата на Фондация „Америка за България“. Изявленията и мненията, изразени в поредицата, принадлежат единствено на Български център за нестопанско право и участващите, автори и говорители и не отразяват непременно вижданията на Фондация Америка за България или нейните партньори.